Một thử nghiệm AI phi tập trung từng chỉ giới hạn trong cộng đồng crypto vừa nhận được sự công nhận công khai từ Jensen Huang, CEO của Nvidia, cho thấy xu hướng huấn luyện mô hình phân tán đang dần tiến gần hơn đến dòng chảy chính của ngành công nghệ.

Động lực phát triển của AI mã nguồn mở đang gia tăng khi nhận được sự ủng hộ từ lãnh đạo Nvidia. Trong một tập của All-In Podcast, Chamath Palihapitiya đã nhấn mạnh dự án Covenant-72B của Bittensor như một minh chứng rõ ràng cho việc AI phi tập trung đang vượt ra khỏi phạm vi lý thuyết.

Bittensor vận hành như một mạng lưới phi tập trung dựa trên blockchain, nơi thiết lập thị trường ngang hàng (peer-to-peer) cho việc trao đổi và khuyến khích tài nguyên tính toán AI cũng như các mô hình machine learning.

Theo Palihapitiya, đây là một mô hình ngôn ngữ lớn (LLM) được huấn luyện mà không cần hạ tầng tập trung, thay vào đó dựa vào đóng góp tài nguyên từ nhiều cá nhân độc lập. Ông mô tả đây là một thành tựu kỹ thuật đáng chú ý khi một mô hình LLaMA với 4 tỷ tham số được huấn luyện hoàn toàn theo phương thức phân tán.

Ông cũng so sánh cách tiếp cận này với các dự án điện toán phân tán trước đây, nơi những người tham gia đóng góp tài nguyên phần cứng dư thừa để cùng vận hành hệ thống.

Jensen Huang: AI phi tập trung và tập trung sẽ cùng tồn tại

Thay vì bác bỏ mô hình này, Jensen Huang đưa ra góc nhìn rộng hơn về thị trường AI, cho rằng các mô hình phi tập trung và độc quyền không loại trừ lẫn nhau mà sẽ cùng song song phát triển.

Ông nhấn mạnh rằng AI nên được xem là một công nghệ, không phải một sản phẩm hoàn chỉnh. Phần lớn người dùng vẫn sẽ tiếp tục sử dụng các hệ thống được tối ưu hóa cao như ChatGPT, Claude hay Gemini, thay vì tự xây dựng mô hình riêng.

Tuy nhiên, với nhiều ngành nghề đặc thù, việc tùy chỉnh mô hình AI là bắt buộc—đặc biệt khi liên quan đến dữ liệu và chuyên môn nội bộ. Trong những trường hợp này, các mô hình mở sẽ đóng vai trò then chốt.

Covenant-72B và bước tiến của AI phi tập trung

Covenant-72B, được phát triển trên Subnet 3 (Templar) của Bittensor, là một trong những nỗ lực huấn luyện mô hình phi tập trung lớn nhất hiện nay. Dự án huy động hơn 70 người tham gia thông qua các kết nối internet tiêu chuẩn, hoàn toàn không có thực thể trung tâm điều phối.

Về mặt kỹ thuật, mô hình này đạt quy mô 72 tỷ tham số và được huấn luyện trên khoảng 1,1 nghìn tỷ token. Nó sử dụng các cải tiến như giao thức truyền thông nén và song song dữ liệu phân tán, giúp việc huấn luyện trở nên khả thi ngoài các trung tâm dữ liệu truyền thống.

Các chỉ số benchmark cho thấy Covenant-72B không chỉ dừng ở mức thử nghiệm mà đã có khả năng cạnh tranh với các mô hình tập trung, qua đó thu hút sự quan tâm vượt ra ngoài cộng đồng crypto.

Thị trường phản ứng và xu hướng tương lai

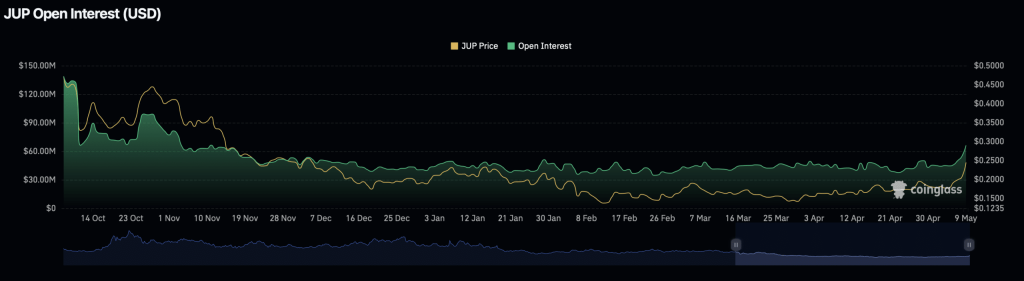

Sau khi thông tin lan rộng, token TAO của dự án đã tăng 24%, phản ánh sự quan tâm ngày càng lớn từ thị trường.

Tuy nhiên, theo Jensen Huang, câu chuyện cốt lõi không phải là sự thay thế mà là sự đồng tồn tại. Các hệ thống AI độc quyền vẫn sẽ chiếm ưu thế ở phân khúc đại chúng, trong khi các mô hình mở và phi tập trung sẽ phát triển mạnh trong những lĩnh vực yêu cầu tùy chỉnh cao, tối ưu chi phí hoặc đảm bảo chủ quyền dữ liệu.

Đối với các startup, ông gợi ý chiến lược thực dụng: bắt đầu với mã nguồn mở, sau đó xây dựng thêm các lợi thế độc quyền.

Nói cách khác, tương lai của AI nhiều khả năng không thuộc về một mô hình duy nhất, mà thuộc về những ai biết cách kết hợp linh hoạt cả hai hướng tiếp cận.

Tin tức Altcoin,Chamath Palihapitiya,taoChamath Palihapitiya,tao#Bittensor #TAO #và #bước #tiến #phân #tán #được #CEO #Nvidia #đánh #giá #cao1773995657